Ce este un fișier Robots.txt? Tot ce aveți nevoie pentru a scrie, trimite și accesa din nou un fișier Robots pentru SEO

Am scris un articol cuprinzător despre modul în care motoarele de căutare găsesc, accesează cu crawlere și indexează site-urile dvs. Un pas fundamental în acest proces este robots.txt fișier, poarta de acces pentru un motor de căutare pentru a vă accesa cu crawlere site-ul. Înțelegerea modului de a construi corect un fișier robots.txt este esențială în optimizarea motoarelor de căutare (SEO).

Acest instrument simplu, dar puternic, îi ajută pe webmasteri să controleze modul în care motoarele de căutare interacționează cu site-urile lor web. Înțelegerea și utilizarea eficientă a unui fișier robots.txt este esențială pentru a asigura o indexare eficientă a unui site web și o vizibilitate optimă în rezultatele motoarelor de căutare.

Ce este un fișier Robots.txt?

Un fișier robots.txt este un fișier text situat în directorul rădăcină al unui site web. Scopul său principal este de a ghida crawlerele motoarelor de căutare despre ce părți ale site-ului ar trebui sau nu ar trebui să fie accesate cu crawlere și indexate. Fișierul folosește protocolul de excludere a roboților (REP), un site-uri web standard utilizat pentru a comunica cu crawlerele web și alți roboți web.

REP nu este un standard oficial de internet, dar este acceptat și susținut pe scară largă de motoarele de căutare majore. Cel mai apropiat de un standard acceptat este documentația de la motoarele de căutare majore precum Google, Bing și Yandex. Pentru mai multe informații, vizitând Specificațiile Google Robots.txt este recomandat.

De ce este Robots.txt critic pentru SEO?

- Accesare cu crawlere controlată: Robots.txt permite proprietarilor de site-uri web să împiedice motoarele de căutare să acceseze anumite secțiuni ale site-ului lor. Acest lucru este util în special pentru excluderea conținutului duplicat, a zonelor private sau a secțiunilor cu informații sensibile.

- Buget optimizat pentru accesare cu crawlere: Motoarele de căutare alocă un buget de accesare cu crawlere pentru fiecare site web, numărul de pagini pe care un bot de motor de căutare le va accesa cu crawlere pe un site. Prin interzicerea secțiunilor irelevante sau mai puțin importante, robots.txt ajută la optimizarea acestui buget de accesare cu crawlere, asigurând că paginile mai semnificative sunt accesate cu crawlere și indexate.

- Timp îmbunătățit de încărcare a site-ului web: Prin împiedicarea accesului roboților la resurse neimportante, robots.txt poate reduce încărcarea serverului, îmbunătățind potențial timpul de încărcare a site-ului, un factor critic în SEO.

- Prevenirea indexării paginilor non-publice: Ajută să nu fie indexate și să apară în rezultatele căutării zonele non-publice (cum ar fi site-urile de realizare sau zonele de dezvoltare).

Comenzile esențiale Robots.txt și utilizările lor

- Permite: Această directivă este folosită pentru a specifica ce pagini sau secțiuni ale site-ului ar trebui să fie accesate de crawler-uri. De exemplu, dacă un site web are o secțiune deosebit de relevantă pentru SEO, comanda „Permite” poate asigura că este accesat cu crawlere.

Allow: /public/- Nu permiteți: Spre deosebire de „Permite”, această comandă instruiește roboții motoarelor de căutare să nu acceseze cu crawlere anumite părți ale site-ului. Acest lucru este util pentru paginile fără valoare SEO, cum ar fi paginile de conectare sau fișierele script.

Disallow: /private/- Wildcards: Wildcardurile sunt folosite pentru potrivirea modelelor. Asteriscul (*) reprezintă orice succesiune de caractere, iar semnul dolar ($) înseamnă sfârșitul unei adrese URL. Acestea sunt utile pentru specificarea unei game largi de adrese URL.

Disallow: /*.pdf$- Sitemap-uri: Includerea unei locații pe harta site-ului în robots.txt ajută motoarele de căutare să găsească și să acceseze cu crawlere toate paginile importante de pe un site. Acest lucru este crucial pentru SEO, deoarece ajută la indexarea mai rapidă și mai completă a unui site.

Sitemap: https://martech.zone/sitemap_index.xmlComenzi suplimentare Robots.txt și utilizările lor

- Agent utilizator: Specificați la ce crawler se aplică regula. „User-agent: *” aplică regula tuturor crawlerelor. Exemplu:

User-agent: Googlebot- Noindex: Deși nu face parte din protocolul standard robots.txt, unele motoare de căutare înțeleg a Noindex directivă în robots.txt ca instrucțiune de a nu indexa adresa URL specificată.

Noindex: /non-public-page/- Întârzierea accesului cu crawlere: Această comandă le cere crawlerilor să aștepte un anumit interval de timp între accesări la serverul dvs., util pentru site-urile cu probleme de încărcare a serverului.

Crawl-delay: 10Cum să vă testați fișierul Robots.txt

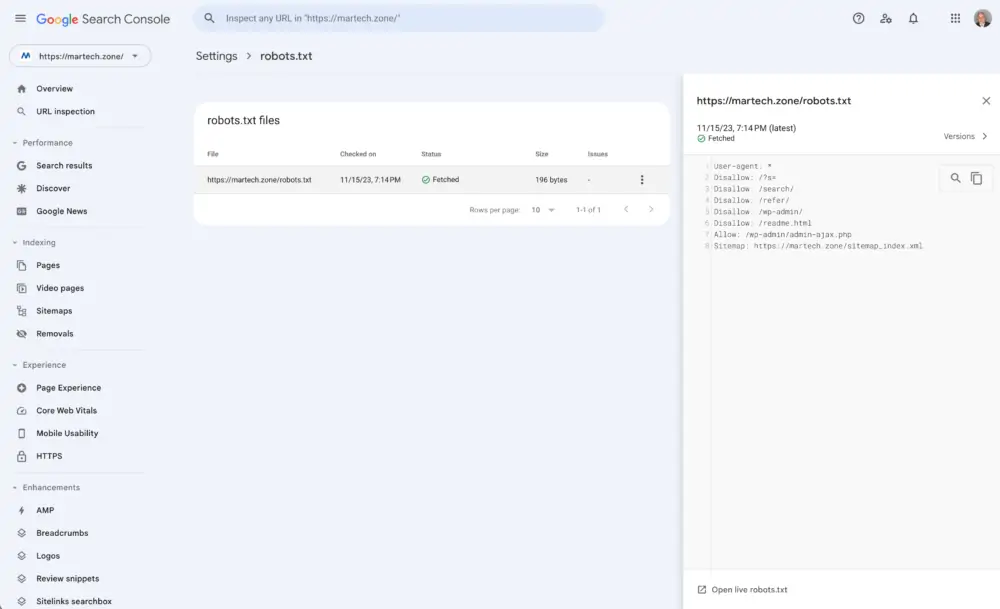

Deși este îngropat în Google Search Console, consola de căutare oferă un tester de fișiere robots.txt.

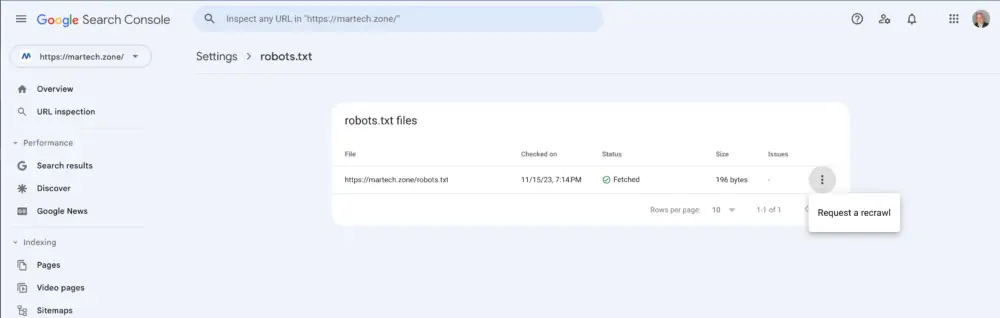

De asemenea, puteți retrimite fișierul Robots.txt făcând clic pe cele trei puncte din dreapta și selectând Solicitați o reexplorare.

Testați sau retrimiteți fișierul Robots.txt

Poate fi folosit fișierul Robots.txt pentru a controla boții AI?

Fișierul robots.txt poate fi utilizat pentru a defini dacă AI roboții, inclusiv crawlerele web și alți roboți automatizați, pot accesa cu crawlere sau utiliza conținutul de pe site-ul dvs. Fișierul ghidează acești roboți, indicând ce părți ale site-ului le este permis sau interzis accesul. Eficacitatea robots.txt care controlează comportamentul roboților AI depinde de mai mulți factori:

- Respectarea protocolului: Cele mai reputate crawler-uri ale motoarelor de căutare și mulți alți roboți AI respectă regulile stabilite

robots.txt. Cu toate acestea, este important să rețineți că fișierul este mai mult o cerere decât o restricție aplicabilă. Boții pot ignora aceste solicitări, în special cele operate de entități mai puțin scrupuloase. - Specificitatea instrucțiunilor: Puteți specifica instrucțiuni diferite pentru diferiți roboți. De exemplu, ați putea permite anumitor roboți AI să acceseze cu crawlere site-ul dvs., în timp ce nu le permiteți altora. Acest lucru se face folosind

User-agentdirectivă înrobots.txtexemplu de fișier de mai sus. De exemplu,User-agent: Googlebotar specifica instrucțiuni pentru crawler-ul Google, în timp ceUser-agent: *s-ar aplica tuturor roboților. - Limitări: In timp ce

robots.txtpoate împiedica roboții să acceseze cu crawlere conținutul specificat; nu le ascunde conținutul dacă o cunosc deja URL-ul. În plus, nu oferă niciun mijloc de a restricționa utilizarea conținutului odată ce acesta a fost accesat cu crawlere. Dacă sunt necesare protecție a conținutului sau restricții specifice de utilizare, ar putea fi necesare alte metode precum protecția prin parolă sau mecanisme mai sofisticate de control al accesului. - Tipuri de roboți: Nu toți roboții AI sunt legați de motoarele de căutare. Diferiți roboți sunt utilizați în scopuri diferite (de exemplu, agregarea datelor, analiza, scrapingul de conținut). Fișierul robots.txt poate fi folosit și pentru a gestiona accesul pentru aceste tipuri diferite de roboți, atâta timp cât respectă REP.

robots.txt fișierul poate fi un instrument eficient pentru a vă semnala preferințele privind accesarea cu crawlere și utilizarea conținutului site-ului de către roboții AI. Cu toate acestea, capacitățile sale se limitează la furnizarea de linii directoare, mai degrabă decât la aplicarea unui control strict al accesului, iar eficacitatea sa depinde de conformitatea roboților cu Protocolul de excludere a roboților.

Fișierul robots.txt este un instrument mic, dar puternic din arsenalul SEO. Poate influența semnificativ vizibilitatea unui site web și performanța motorului de căutare atunci când este utilizat corect. Controlând ce părți ale unui site sunt accesate cu crawlere și indexate, webmasterii se pot asigura că conținutul lor cel mai valoros este evidențiat, îmbunătățindu-și eforturile SEO și performanța site-ului.